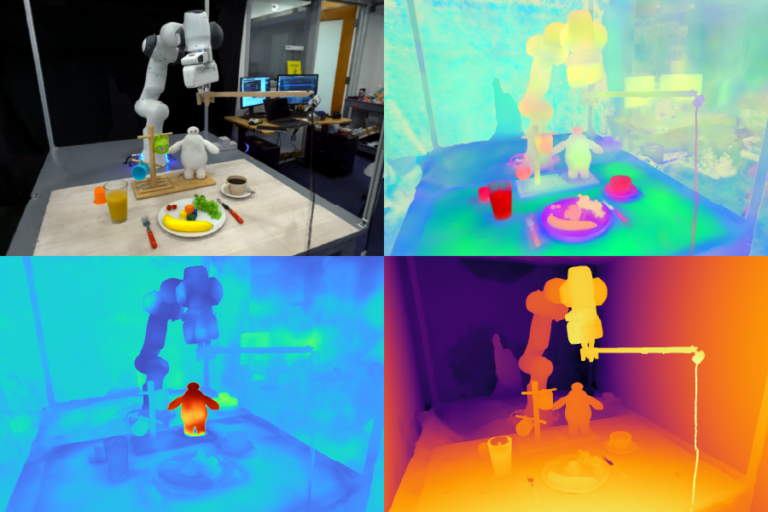

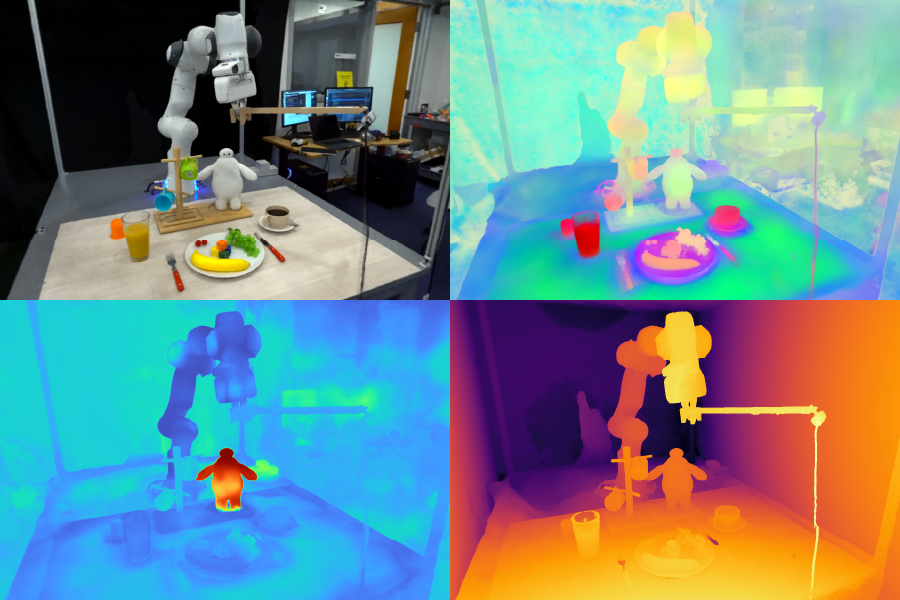

Поля функций для роботизированных манипуляций (F3RM) позволяют роботам интерпретировать открытые текстовые подсказки на естественном языке, помогая машинам манипулировать незнакомыми объектами. Поля трехмерных функций системы могут быть полезны в средах, содержащих тысячи объектов, таких как склады. Изображения предоставлены исследователями.

Алекс Шиппс | MIT CSAIL

Представьте, что вы находитесь в гостях у друга за границей и заглядываете в его холодильник, чтобы узнать, что подойдет для отличного завтрака. Многие предметы поначалу кажутся вам чужими, поскольку каждый из них заключен в незнакомую упаковку и контейнеры. Несмотря на эти визуальные различия, вы начинаете понимать, для чего используется каждый из них, и подбирать их по мере необходимости.

Вдохновленная способностью людей обращаться с незнакомыми объектами, группа из Лаборатории компьютерных наук и искусственного интеллекта Массачусетского технологического института (CSAIL) разработала поля функций для роботизированных манипуляций (рис.Ф3РМ), систему, которая объединяет 2D-изображения с особенностями модели фундамента в 3D-сцены, чтобы помочь роботам идентифицировать и захватывать близлежащие предметы. Ф3РМ может интерпретировать открытые языковые подсказки людей, что делает этот метод полезным в реальных средах, содержащих тысячи объектов, таких как склады и домашние хозяйства.

F3RM предлагает роботам возможность интерпретировать открытые текстовые подсказки на естественном языке, помогая машинам манипулировать объектами. В результате машины могут понимать менее конкретные запросы людей и при этом выполнять желаемую задачу. Например, если пользователь попросит робота «поднять высокую кружку», робот сможет найти и взять предмет, который лучше всего соответствует этому описанию.

«Создать роботов, которые действительно могут действовать в реальном мире, невероятно сложно», — говорит Гэ Ян, постдок в Институте искусственного интеллекта и фундаментальных взаимодействий Национального научного фонда и MIT CSAIL. «Мы действительно хотим выяснить, как это сделать, поэтому в этом проекте мы пытаемся добиться агрессивного уровня обобщения, от трех или четырех объектов до всего, что мы находим в Статцентре Массачусетского технологического института. Мы хотели научиться делать роботов такими же гибкими, как мы сами, поскольку мы можем захватывать и размещать объекты, даже если никогда раньше их не видели».

Изучение «что где, глядя»

Этот метод может помочь роботам выбирать товары в крупных центрах выполнения заказов с неизбежным беспорядком и непредсказуемостью. На этих складах роботам часто дают описание инвентаря, который они должны идентифицировать. Роботы должны сопоставлять текст, предоставленный объекту, независимо от различий в упаковке, чтобы заказы клиентов доставлялись правильно.

Например, центры выполнения крупных интернет-магазинов могут содержать миллионы товаров, со многими из которых робот никогда раньше не сталкивался. Чтобы работать в таком масштабе, роботам необходимо понимать геометрию и семантику различных предметов, причем некоторые из них находятся в ограниченном пространстве. Благодаря расширенным способностям пространственного и семантического восприятия F3RM робот может стать более эффективным в обнаружении объекта, помещении его в корзину, а затем отправке его на упаковку. В конечном итоге это поможет работникам фабрики более эффективно доставлять заказы клиентам.

«Одна вещь, которая часто удивляет людей с F3RM, заключается в том, что та же система также работает в масштабе комнаты и здания и может использоваться для создания симуляционных сред для обучения роботов и больших карт», — говорит Янг. «Но прежде чем мы расширим эту работу дальше, мы хотим сначала заставить эту систему работать очень быстро. Таким образом, мы можем использовать этот тип представления для более динамичных задач управления роботами, будем надеяться, в режиме реального времени, чтобы роботы, выполняющие более динамичные задачи, могли использовать его для восприятия».

Команда MIT отмечает, что способность F3RM понимать различные сцены может сделать его полезным в городских и домашних условиях. Например, этот подход может помочь персонализированным роботам идентифицировать и подбирать определенные предметы. Система помогает роботам воспринимать окружающую среду — как физически, так и воспринимаемо.

«Визуальное восприятие было определено Дэвидом Марром как проблема знания того, «что находится и где, глядя», — говорит старший автор. Филипп Изола, доцент кафедры электротехники и информатики Массачусетского технологического института и главный исследователь CSAIL. «Недавние модели фундаментов стали действительно хорошо понимать, на что они смотрят; они могут распознавать тысячи категорий объектов и предоставлять подробные текстовые описания изображений. В то же время поля излучения стали очень хорошо отображать расположение объектов в сцене. Комбинация этих двух подходов может создать представление о том, что и где находится в 3D, и наша работа показывает, что эта комбинация особенно полезна для роботизированных задач, которые требуют манипулирования объектами в 3D».

Создание «цифрового двойника»

F3RM начинает понимать свое окружение, фотографируя на палку для селфи. Установленная камера делает 50 снимков в разных позах, что позволяет создать нейронное поле излучения (NeRF), метод глубокого обучения, который использует 2D-изображения для построения 3D-сцены. Этот коллаж из фотографий RGB создает «цифрового двойника» окружающей среды в виде 360-градусного изображения того, что находится поблизости.

В дополнение к высокодетализированному полю нейронного излучения F3RM также создает поле признаков для дополнения геометрии семантической информацией. Система использует КЛИП, модель основы зрения, обученная на сотнях миллионов изображений для эффективного изучения визуальных концепций. Реконструируя функции 2D CLIP для изображений, сделанных с помощью палки для селфи, F3RM эффективно преобразует 2D-функции в 3D-представление.

Держите вещи открытыми

После нескольких демонстраций робот применяет свои знания о геометрии и семантике, чтобы захватывать объекты, с которыми он никогда раньше не сталкивался. Как только пользователь отправляет текстовый запрос, робот просматривает пространство возможных захватов, чтобы определить те из них, которые с наибольшей вероятностью преуспеют в подборе запрошенного пользователем объекта. Каждый потенциальный вариант оценивается на основе его соответствия подсказке, сходства с демонстрациями, на которых обучался робот, и того, вызывает ли он какие-либо столкновения. Затем выбирается и выполняется захват с наибольшим количеством баллов.

Чтобы продемонстрировать способность системы интерпретировать открытые запросы людей, исследователи предложили роботу взять Бэймакса, персонажа из диснеевского «Большого героя 6». Хотя F3RM никогда не обучался напрямую брать игрушку мультяшного супергероя, робот использовал свое пространственное восприятие и особенности языка видения из базовой модели, чтобы решить, какой объект схватить и как его поднять.

F3RM также позволяет пользователям указывать, с каким объектом робот должен работать на разных уровнях лингвистической детализации. Например, если есть металлическая кружка и стеклянная кружка, пользователь может попросить у робота «стеклянную кружку». Если бот видит две стеклянные кружки и одна из них наполнена кофе, а другая — соком, пользователь может попросить «стеклянную кружку с кофе». Функции базовой модели, встроенные в поле функций, обеспечивают такой уровень открытого понимания.

«Если бы я показал человеку, как брать кружку за губу, он мог бы легко применить эти знания, чтобы брать предметы схожей геометрии, такие как миски, мерные стаканы или даже рулоны ленты. Для роботов достижение такого уровня адаптивности было довольно сложной задачей», — говорит аспирант Массачусетского технологического института, филиал CSAIL и соведущий автор. Уильям Шен. «F3RM сочетает в себе геометрическое понимание с семантикой базовых моделей, обученных на данных интернет-масштаба, чтобы обеспечить такой уровень агрессивного обобщения на основе всего лишь небольшого количества демонстраций».

Шен и Янг написали статью под руководством Изолы, соавторами выступили профессор Массачусетского технологического института и главный исследователь CSAIL Лесли Пак Кэлблинг и студенты бакалавриата Алан Ю и Янсен Вонг. Группу частично поддержали Amazon.com Services, Национальный научный фонд, Управление научных исследований ВВС, Многопрофильная университетская инициатива Управления военно-морских исследований, Армейский исследовательский офис, Лаборатория Уотсона MIT-IBM и Массачусетский технологический институт: В поисках разведки. Их работа будет представлена на конференции по обучению роботов 2023 года.

Новости Массачусетского технологического института